Токсичность твитов

Введение

01. Выбор данных:

— Для анализа был выбран датасет «Twitter Toxic Tweets» в формате CSV найденный на платформе Kaggle — одном из крупнейших открытых ресурсов с наборами данных для анализа и машинного обучения.Данный датасет содержит 31 962 реальных сообщения из социальной сети Twitter, собранных из публичных источников. Каждый твит размечен по бинарному признаку токсичности: 1 — токсичный твит, 0 — нетоксичный твит.

02. Причины выбора данного датасета

— Обучаясь на образовательной программе «Дизайн и продвижение цифрового продукта», я в рамках учебной и практической деятельности работаю с социальными сетями и задачами продвижения цифрового контента. В связи с этим изучение поведения пользователей в онлайн-среде представляет для меня профессиональный интерес.

Анализ сообщений из Twitter позволяет исследовать характер распространения негативных высказываний и особенности публичной онлайн-коммуникации.

Выбранный датасет является релевантным как для образовательных задач, для формирования профессиональных навыков в области дизайна и продвижения цифровых продуктов.

03. Принцип выбора видов графиков:

Для визуализации и анализа данных были выбраны несколько типов графиков, каждый из которых решает определённую аналитическую задачу и позволяет по-разному интерпретировать информацию.

(1) Гистограммы были использованы для анализа распределения твитов по признаку токсичности. Этот тип графика позволяет наглядно оценить соотношение токсичных и нетоксичных сообщений в датасете.

(2) Столбчатые диаграммы применялись для сравнения количества твитов в различных категориях. Они удобны для сопоставления значений и хорошо подходят для объясняющего формата визуализации.

(3) Круговые диаграммы использовались для отображения долей токсичного и нетоксичного контента в общем объёме данных. Такой формат позволяет быстро донести ключевые выводы до широкой аудитории.

(4) Сложенные графики применялись для демонстрации структуры данных и одновременного отображения нескольких показателей, что позволяет выявить взаимосвязи между различными аспектами токсичности.

Выбор данных типов визуализаций обусловлен их наглядностью, универсальностью и возможностью использования в едином визуальном стиле в рамках исследовательского проекта.

Этапы работы

01. Стиль

Для графиков использованы кислотные оттенки, уравновешенные серым, чтобы подчеркнуть идею токсичности. Шрифт Inter выбран за широкое применение в цифровой верстке и хорошую читаемость на экранах.

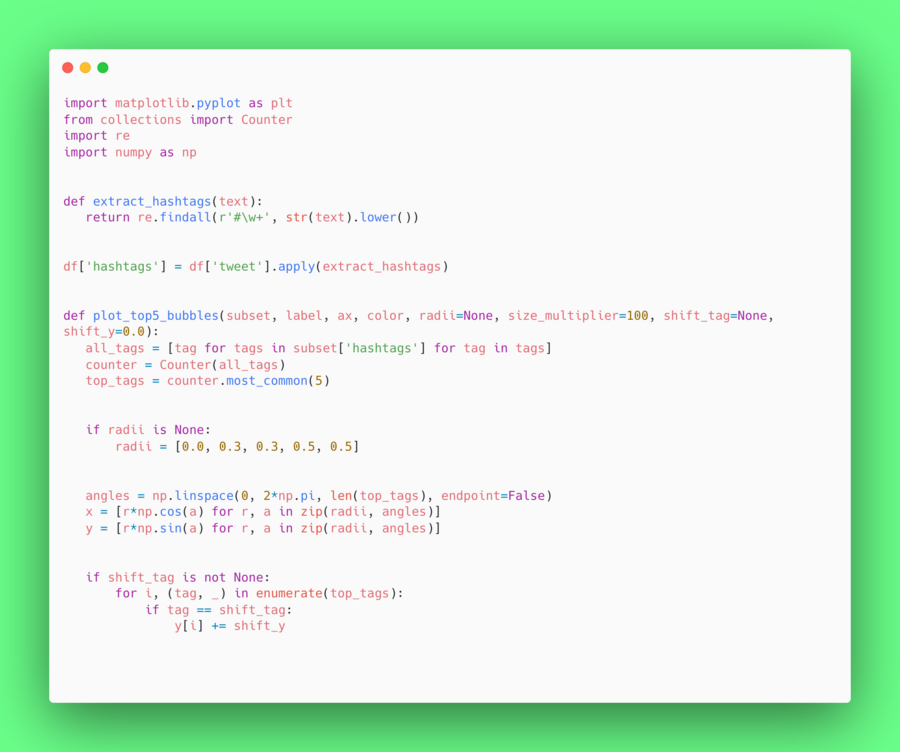

02. Импорт библиотек

Для реализации проекта был выбран стек библиотек Python, обеспечивающий полный цикл работы с данными: от очистки до финальной визуализации.

03. Добавление шрифтов

Далее я импортировала файл IBM Mono шрифта в Google Collab, создала объект шрифта FontProperties, указав путь к локальному файлу IBM Plex Mono (.ttf).

Это позволяет Matplotlib использовать именно этот шрифт.

04. Импорт датасета

Так как я работала в среде Google Collab, то сначала загрузила датасет туда. А затем я импортировала данные с помощью библиотеки Pandas. Файл twitter_toxic_tweets.csv был преобразован в объект DataFrame, что позволило мне легко фильтровать твиты по их типу (токсичные/нетоксичные) и проводить дальнейшие операции

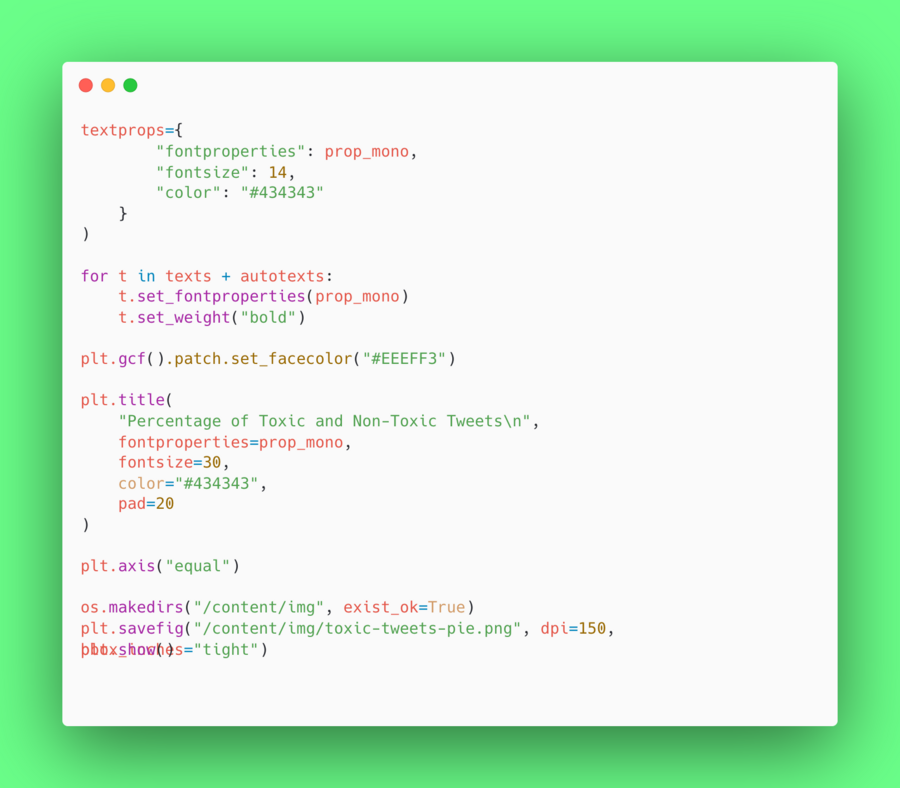

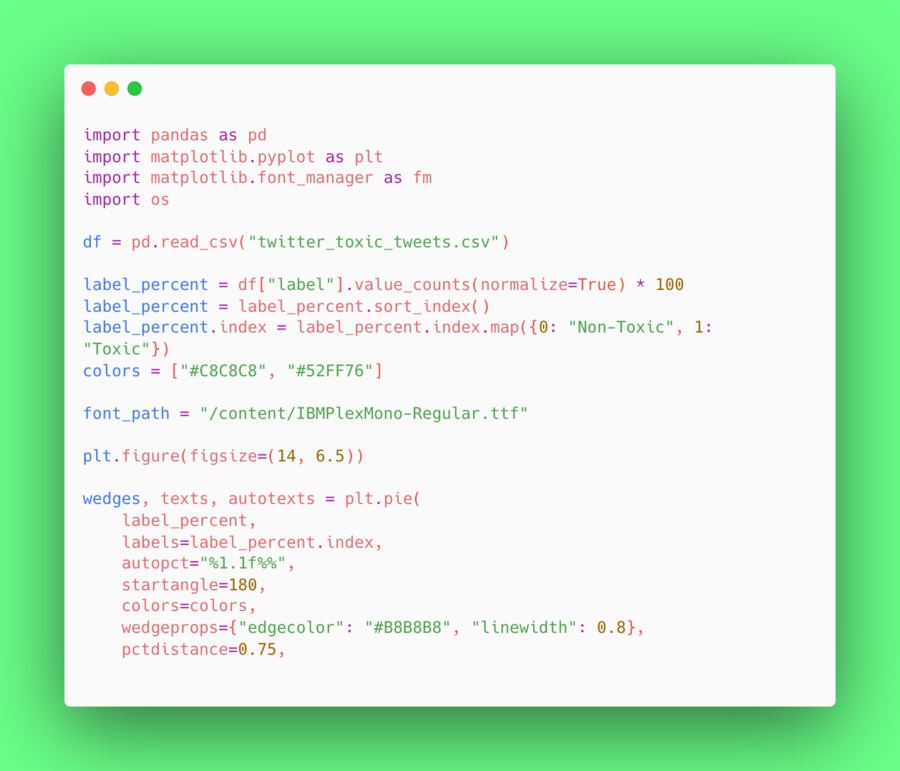

(1) Процент токсичных и нетоксичных твитов

На графике представлена круговая диаграмма, показывающая распределение твитов по категориям «Toxic» и «Non-Toxic».

Из диаграммы становится ясно, что большинство твитов являются нетоксичными (93%).

Токсичные твиты составляют меньшую долю (7%).

(1) Процентное соотношение токсичных и нетоксичных твитов в датасете

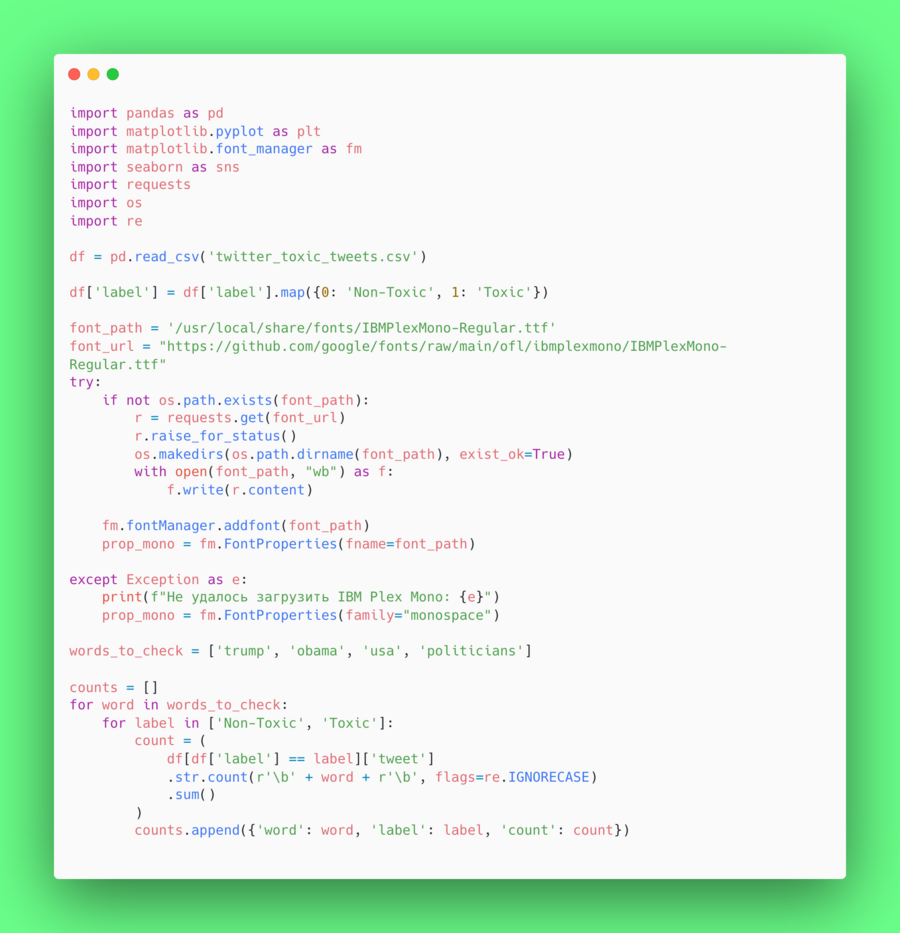

(1) код

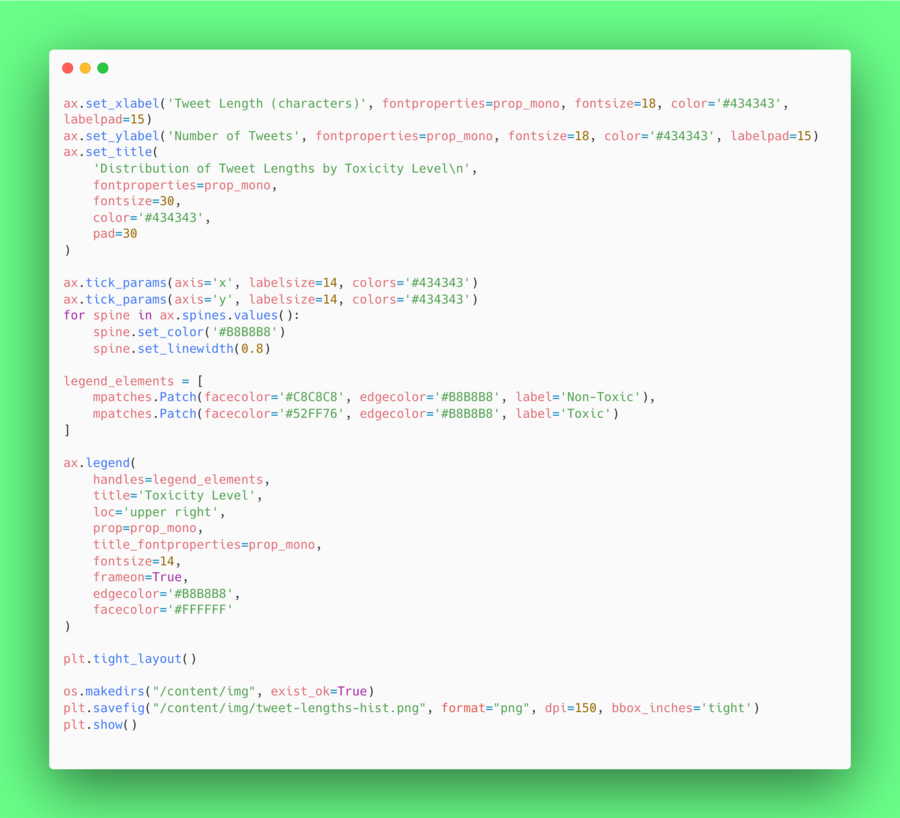

(2) Распределение длины твитов по токсичности

Для построения этой диаграммы нам важно было учитывать точное количество символов в каждом твите, так как весь анализ опирался на длину сообщений.

В исходном датасете часть данных была загрязнена: встречались пустые строки или записи с бессмысленными символами.

В коде такие записи автоматически исключались при вычислении длины твитов и при преобразовании бинарных меток (0/1 в Non-Toxic/Toxic).

(2) Распределение длины твитов по категориям токсичности

Гистограмма показывает, как распределена длина твитов в датасете в зависимости от их токсичности. Большинство нетоксичных твитов имеют среднюю длину, что видно по высокому пику серого цвета.

Токсичные твиты распределены более равномерно и встречаются как короткие, так и длинные.

График позволяет визуально оценить различия в длине твитов между категориями, что может быть полезно для анализа контента и дальнейшей фильтрации.

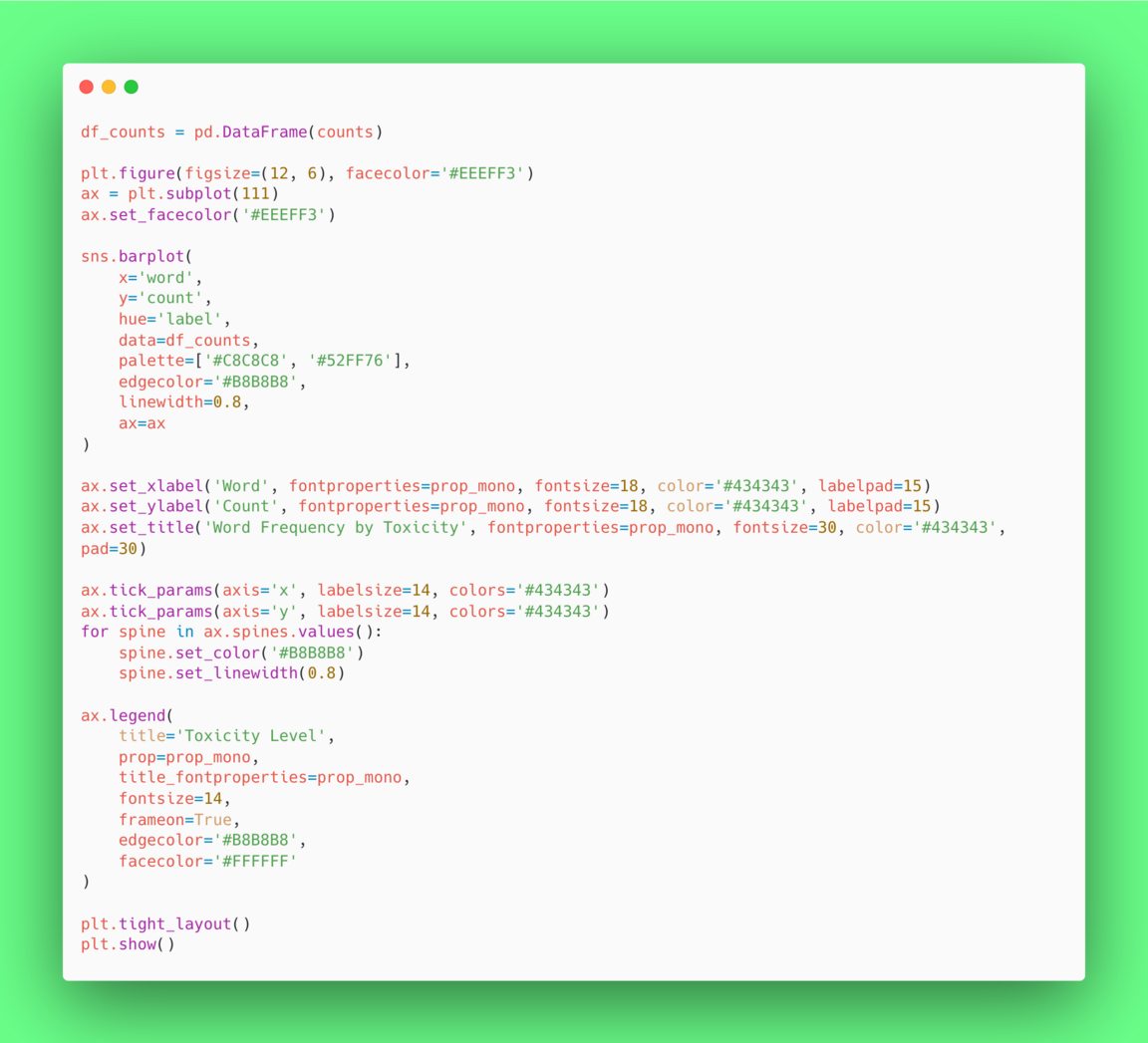

(3) Частота встречаемости определенных слов в твитах в зависимости от токсичности

Диаграмма показывает, как часто встречаются слова «trump», «obama», «usa» и «politicians» в твитах разных категорий.

Барплот позволяет сравнивать частоту слов между категориями токсичных и нетоксичных твитов.

Слова «trump» и «obama» встречаются чаще в токсичных твитах, чем в нетоксичных.

Слово «usa» активно встречается в обоих типах твитов, но преимущественно в нетоксичных.

«Politicians» встречается реже, но заметно чаще в токсичных твитах.

Диаграмма помогает визуально оценить, какие слова чаще ассоциируются с токсичными или нетоксичными сообщениями.

(3) Частота встречаемости определенных слов в твитах в зависимости от токсичности.

(3) код

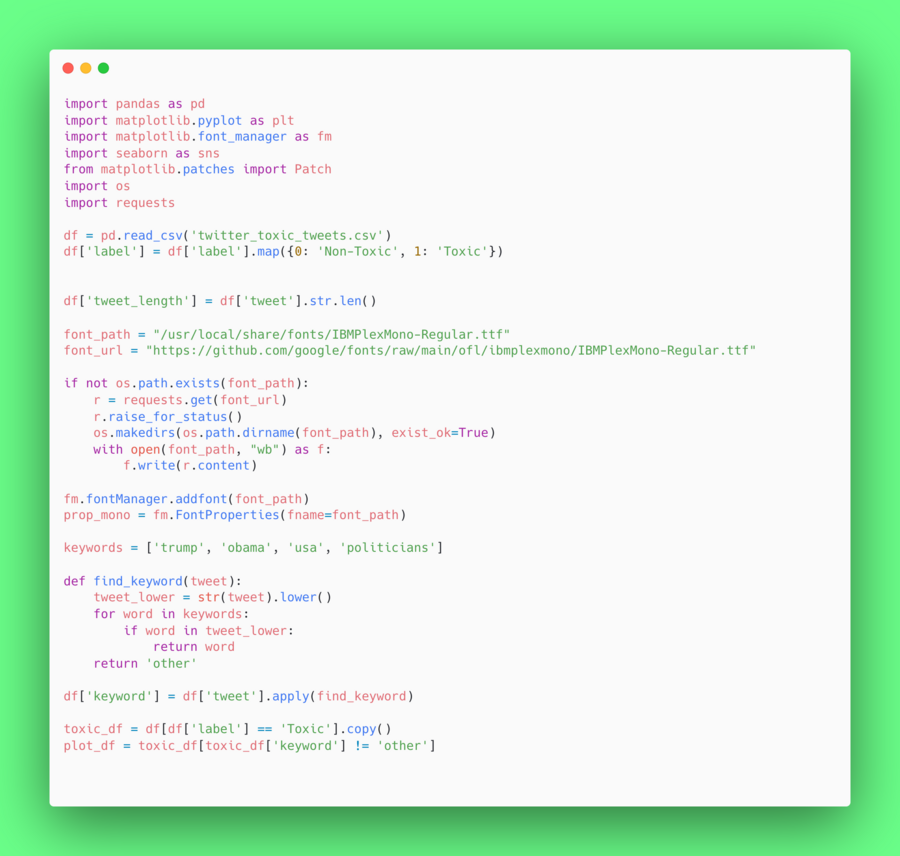

(4) Распределение длины токсичных твитов по ключевым словам

График представляет распределение длины токсичных твитов, содержащих ключевые слова: trump, obama, usa, politicians.

Диаграмма показывает, как меняется длина твитов с токсическим содержанием в зависимости от присутствующих ключевых слов.

По ключевым словам видно, что распределение длины твитов примерно схожее, без резких различий, хотя отдельные слова имеют больше коротких или длинных твитов.

Таким образом, график помогает визуально оценить, как ключевые слова распределены по длине токсичных сообщений, что может быть полезно для анализа содержания и структуры токсичных твитов.

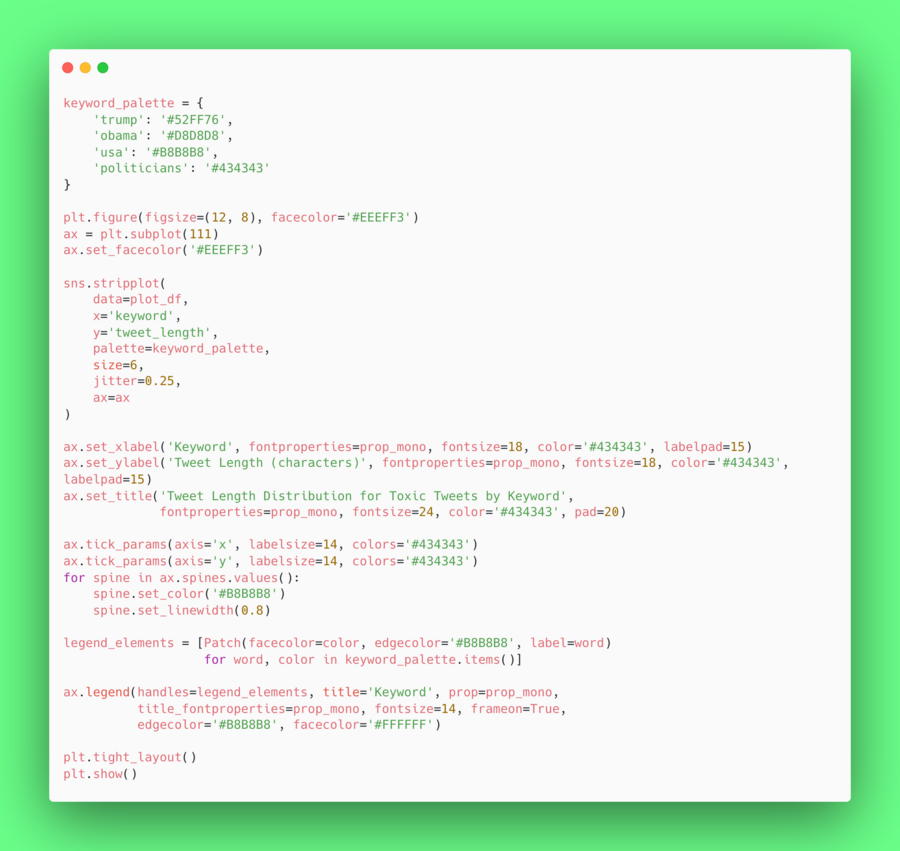

(4) Распределение длины токсичных твитов по ключевым словам

(4) код

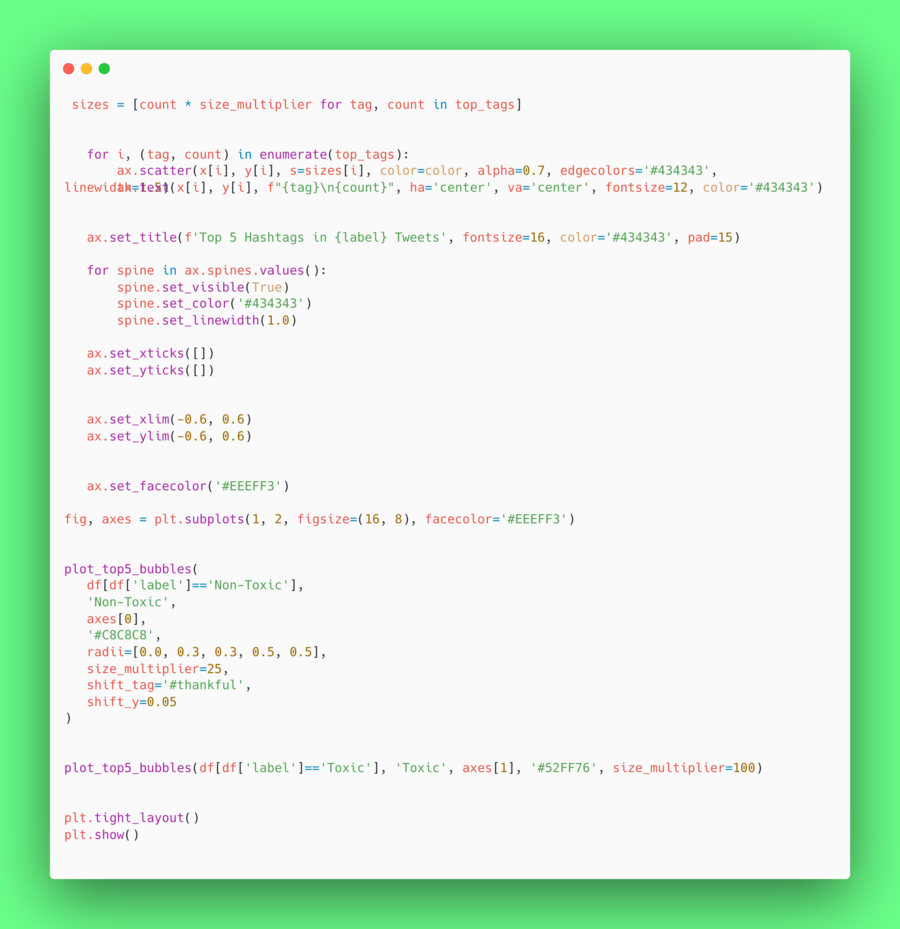

(7) Топ-5 хэштегов в твитах по категориям

График состоит из двух диаграмм-пузырьков, показывающих топ-5 хэштегов в твитах в зависимости от их токсичности. Каждый пузырь соответствует конкретному хэштегу, а размер пузыря пропорционален частоте его использования. Под пузырями указаны хэштеги и количество их вхождений.

Диаграмма позволяет наглядно увидеть, какие хэштеги чаще встречаются в токсичных и нетоксичных твитах. Non-Toxic твиты преимущественно содержат позитивные или нейтральные хэштеги, тогда как в Toxic твитах встречаются активные обсуждения или конфликтные темы.

Bubble Chart демонстрирует относительную популярность ключевых хэштегов и различия в темах между двумя группами твитов.

(7) топ-5 хэштегов в твитах по категориям

Выводы

В ходе анализа твитов мы исследовали их токсичность, распределение длины сообщений, популярные ключевые слова и хэштеги.

Распределение токсичных и нетоксичных твитов (Pie Chart) показало, что большинство сообщений — нетоксичные (~93%), а токсичные составляют меньшую долю (~7%).

Длина твитов (Histogram и Stripplot) продемонстрировала, что большинство сообщений короткие, однако токсичные твиты могут быть длиннее, особенно с определенными ключевыми словами (trump, obama, usa, politicians). Этот анализ позволил выделить закономерности использования слов в токсичных твитах.

Популярные слова (Barplot) показали, какие слова чаще встречаются в токсичных и нетоксичных твитах, позволяя понять тематику сообщений и эмоциональную окраску.

Популярные хэштеги (Bubble Chart) наглядно демонстрировали, что нетоксичные твиты используют позитивные или нейтральные хэштеги, а токсичные твиты содержат более спорные или эмоционально окрашенные хэштеги.

В целом, проект показал, что токсичность твитов связана с определенными словами, хэштегами и длиной сообщений. Анализ позволил визуально и количественно оценить различия между токсичным и нетоксичным контентом.

Источники данных

Twitter Toxic Tweets // Kaggle URL: https://www.kaggle.com/datasets/umitka/twitter-toxic-tweets (дата обращения: 19.11.2025)